Keberhasilan Artificial Intelligence (AI) telah membawa banyak perubahan signifikan dalam berbagai aspek kehidupan kita. Namun, penting untuk diingat bahwa algoritma dilatih pada data yang kurang beragam, sehingga dapat menyebabkan bias data dalam AI. Bias data adalah masalah serius yang dapat mempengaruhi pengambilan keputusan AI dan memberikan konsekuensi negatif. Dalam artikel ini, kita akan menjelaskan apa itu bias data, bagaimana hal ini terjadi, sumber bias data dalam AI, dan bagaimana mengatasi masalah ini.

Apa itu bias AI?

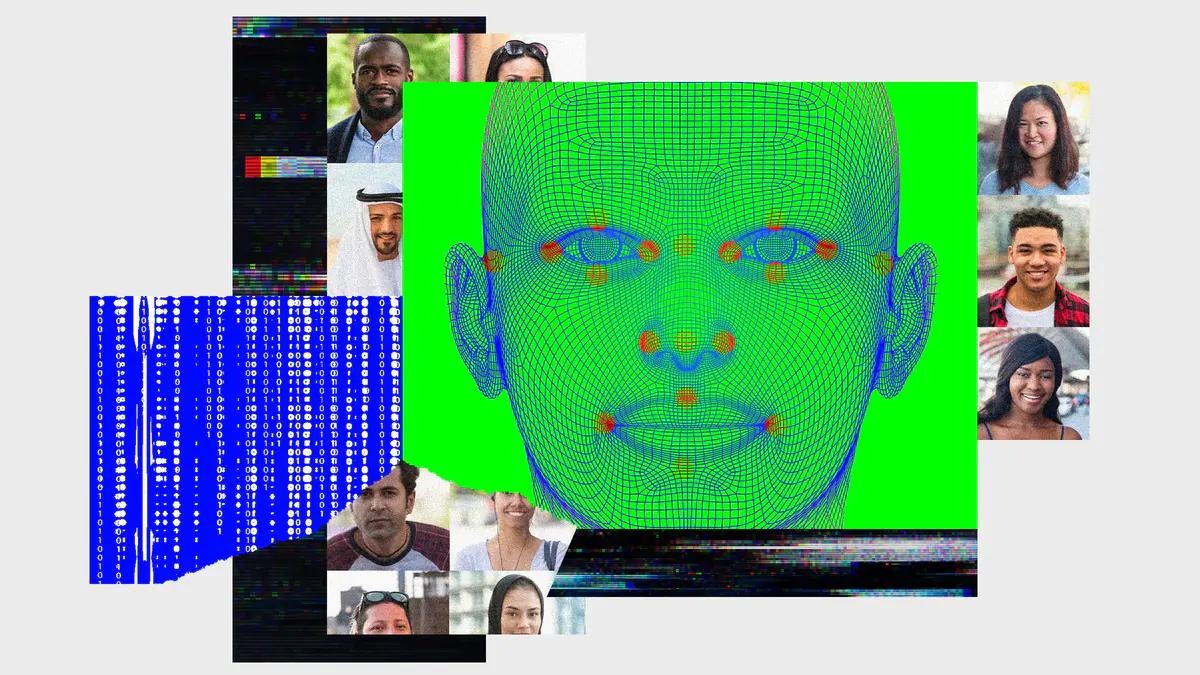

Bias machine learning (pembelajaran mesin), juga dikenal sebagai bias algoritma atau bias artificial intelligence, mengacu pada kecenderungan algoritma mencerminkan bias manusia. Ini adalah fenomena yang muncul ketika suatu algoritma memberikan hasil yang bias secara sistematis sebagai konsekuensi dari asumsi yang salah dalam proses machine learning. Dalam konteks keberagaman yang semakin meningkat saat ini, hal ini menjadi semakin bermasalah karena algoritma dapat memperkuat bias.

Misalnya, di Amerika, algoritma pengenalan wajah dapat dilatih untuk mengenali orang berkulit putih dengan lebih mudah dibandingkan orang berkulit hitam karena jenis data ini lebih sering digunakan dalam suatu pelatihan. Hal ini dapat berdampak negatif terhadap kelompok minoritas, karena diskriminasi menghalangi persamaan kesempatan dan melanggengkan penindasan. Masalahnya adalah bias ini tidak disengaja, dan sulit untuk mengetahuinya sampai bias tersebut diprogram ke dalam perangkat lunak.

Bagaimana bias data dapat terjadi

Bias data terjadi ketika data yang digunakan untuk melatih model AI tidak mewakili dunia nyata dengan baik, dan data ini memiliki perbedaan tertentu. Bias data dapat berasal dari beberapa sumber, dan ini dapat memiliki dampak serius pada model AI. Berikut beberapa cara bagaimana bias data terjadi.

- Sampel yang tidak representatif: Ketika data hanya mencakup sebagian kecil populasi atau terlalu terfokus pada satu kelompok, hasilnya dapat menjadi bias. Misalnya, jika sebuah model diberi data yang sebagian besar terdiri dari gambar orang kulit putih, maka kemungkinan besar model ini akan memiliki kesulitan dalam mengenali wajah dari kelompok etnis lain.

- Labeling data yang tidak akurat: Data pelatihan dapat menjadi bias jika label yang digunakan tidak benar atau tidak akurat. Jika, misalnya, data yang digunakan memiliki label yang salah untuk jenis kelamin seseorang atau atribut lainnya, maka model AI dapat menghasilkan hasil yang tidak akurat.

- Sumber data yang tidak seimbang: Ketidakseimbangan dalam jumlah data dari berbagai kelas atau atribut dapat menyebabkan bias. Misalnya, dalam konteks medis, jika data pasien pria jauh lebih banyak daripada data pasien wanita, model AI mungkin lebih baik dalam mendiagnosis penyakit pada pria daripada pada wanita.

- Bias manusia: Data yang dihasilkan atau dikumpulkan oleh manusia dapat mencerminkan bias individu. Manusia yang terlibat dalam pengumpulan data atau penentuan label dapat membawa pandangan subjektif atau bias mereka sendiri ke dalam proses.

Jenis bias data dalam AI

Bias dalam AI dapat muncul dalam berbagai bentuk. Berikut adalah beberapa jenis bias yang umum ditemui dalam AI.

- Bias historis: Saat mengumpulkan data untuk melatih algoritma machine learning, mengambil data historis hampir selalu merupakan cara termudah untuk memulai. Namun, jika kita tidak berhati-hati, sangat mudah untuk memasukkan bias yang ada dalam data historis.

- Bias sampel: Bias sampel terjadi ketika kumpulan data tidak mencerminkan realitas di mana model akan berjalan. Contohnya adalah sistem pengenalan wajah yang dilatih terutama pada gambar pria kulit putih. Model-model ini memiliki tingkat akurasi yang jauh lebih rendah dengan wanita dan orang-orang dari etnis yang berbeda. Bias selekse adalah nama lain untuk bias jenis ini.

- Bias Rasial: Bias rasial terjadi ketika sistem AI memberikan perlakuan yang tidak adil atau tidak akurat berdasarkan ras atau etnisitas. Ini dapat mencakup kesalahan pengenalan wajah pada individu dengan warna kulit yang lebih gelap atau penilaian kredit yang didasarkan pada ras.

- Bias Label: Bias label terjadi ketika label yang digunakan dalam data pelatihan tidak akurat atau mencerminkan bias manusia. Ini dapat terjadi jika label diberikan oleh manusia yang memiliki pandangan subjektif atau prasangka.

Contoh bias dalam AI

Bias data benar-benar dapat terjadi dan sudah terdapat beberapa kasus di mana artificial intelligence mengalami bias data. Berikut adalah beberapa contoh di mana bias data terjadi dalam kehidupan nyata.

Proses perekrutan di Amazon

Amazon pernah mengembangkan alat otomatis untuk menilai resume pelamar pekerjaan. Namun, alat ini mengalami bias gender yang signifikan. Ini karena algoritma didasarkan pada data pelatihan historis yang didominasi oleh laki-laki dalam pekerjaan teknis. Algoritma ini secara tidak sengaja menyaring secara otomatis resume perempuan, bahkan jika mereka memiliki kualifikasi yang kuat. Insiden ini menjadi contoh nyata tentang bagaimana bias gender dalam data pelatihan dapat menciptakan ketidaksetaraan.

Software hukuman Compas

Correctional Offender Management Profiling for Alternative Sanctions (COMPAS) adalah alat manajemen kasus dan pendukung keputusan yang dikembangkan dan dimiliki oleh Northpointe (sekarang Equivant) yang digunakan oleh pengadilan AS untuk menilai kemungkinan terdakwa menjadi residivis.

Sistem Compas digunakan oleh sistem peradilan pidana untuk memprediksi risiko kriminalitas dan membantu dalam pengambilan keputusan hukuman. Namun, penelitian menunjukkan bahwa sistem ini memiliki bias rasial, dengan lebih sering memberikan tingkat risiko yang lebih tinggi kepada individu berkulit gelap. Hal ini mencerminkan bias dalam data historis dan pergeseran dalam penegakan hukum.

Google Photo tagging

Pada tahun 2015, Google Photos memicu kontroversi ketika sistem penandaannya secara otomatis menandai foto seseorang sebagai “gorila,” yang mengejutkan dan sangat tidak pantas. Masalah ini mencerminkan bias dalam model pengenalan gambar yang memiliki kesulitan dalam mengenali wajah dengan warna kulit yang lebih gelap.

Masalah yang timbul ketika terjadi bias dalam AI

Data yang bias memang buruk, namun implikasi akhirnya jauh lebih buruk. Seperti contoh di atas, bias data dapat memengaruhi segala hal. Bagi bisnis, bias data dapat mempengaruhi analisis biaya saat memutuskan apakah akan mempertahankan atau menghentikan suatu program. Faktanya, responden survei Forrester Consulting memperkirakan mereka membuang lebih dari 20% anggaran pemasaran karena data yang buruk.

Berikut adalah beberapa masalah yang timbul ketika bias hadir dalam AI:

- Peluang yang terlewatkan: Dunia digital bergerak dengan sangat cepat dan kita tidak dapat mengambil keputusan berdasarkan data yang bias. Hal ini dapat menyebabkan hilangnya peluang untuk konversi, peningkatan penjualan, dan retensi, karena suatu bisnis beroperasi berdasarkan insight dan data yang salah.

- Ketidakadilan dalam berbagai aspek: Bias dalam AI dapat mengakibatkan ketidakadilan dalam pengambilan keputusan. Ini bisa terjadi dalam berbagai konteks, termasuk peradilan, keuangan, rekrutmen, dan sektor lainnya. Ketidakadilan ini dapat mengarah pada perlakuan diskriminatif terhadap kelompok-kelompok tertentu, seperti kelompok rasial, gender, usia, atau etnis.

- Ketidakakuratan diagnosis medis: Dalam penggunaan AI di bidang medis, bias dapat mengakibatkan diagnosis yang tidak akurat, terutama jika model tidak dapat dengan benar mengenali kelompok etnis tertentu atau kondisi medis yang kurang umum.

- Penyaringan konten media sosial yang salah: Algoritma penyaringan media sosial yang bias dapat menghapus konten yang sah dan tidak melanggar aturan, tentunya itu sangat merugikan banyak pihak. Hal ini juga dapat memengaruhi kebebasan berbicara dan dampak pada kebebasan individu.

Apa yang bisa dilakukan untuk mengatasi bias dalam AI?

Penting untuk mengenali dan mengatasi bias data dalam AI karena bias dapat menyebabkan ketidakadilan, diskriminasi, dan hasil yang tidak akurat. Berikut beberapa metode untuk mengatasi bias data dalam AI.

Pengumpulan data yang seimbang dan evaluasi

Salah satu cara paling langsung untuk mengatasi bias data adalah dengan memastikan bahwa data yang digunakan untuk melatih model seimbang. Ini berarti memiliki jumlah sampel yang cukup dari semua kelas atau atribut yang relevan. Kemudian, pemeriksaan dan evaluasi terus-menerus terhadap model AI untuk mendeteksi bias adalah langkah penting. Ini melibatkan pengujian model pada berbagai situasi dan menganalisis apakah model tersebut memberikan hasil yang adil.

Transparansi dan pembersihan data

Membuat model AI yang lebih transparan hasilnya dapat membantu mengidentifikasi dan mengatasi bias. Dengan memahami cara model membuat keputusan, kita dapat mengidentifikasi sumber bias. Selain itu, mengidentifikasi dan menghilangkan data yang cacat atau bias dapat membantu meningkatkan akurasi hasil yang diinginkan. Ini mungkin memerlukan penghapusan atau penyesuaian data yang menciptakan bias.

Keragaman tim pengembang

Membentuk tim pengembang yang beragam dapat membantu mengurangi bias dalam pengumpulan data, labeling, dan pemodelan. Perspektif yang beragam dapat membantu mendeteksi bias yang mungkin terlewatkan oleh individu atau kelompok tertentu.

Data bias dalam AI adalah tantangan serius yang dapat mempengaruhi akurasi dan keadilan model kecerdasan buatan. Dalam menghadapi perkembangan teknologi AI yang pesat, penting bagi kita untuk mengenali, memahami, dan mengatasi masalah data bias. Dengan tindakan yang tepat, kita dapat memastikan bahwa AI yang kita kembangkan tidak hanya kuat secara teknis, tetapi juga etis dan adil dalam pengambilan keputusan. Dengan menjaga kesadaran tentang bias data, kita dapat memastikan bahwa AI memberikan manfaat yang maksimal bagi masyarakat dan tidak menimbulkan dampak negatif yang tidak diinginkan.

Itulah informasi seputar bias data dalam AI yang berdampak buruk karena dapat memberikan hasil yang tidak tepat. Dengan perkembangan teknologi yang terus berlanjut, penggunaan AI di bidang apa pun akan menjadi lebih canggih dan terjangkau. Kunjungi blog MetaNesia untuk mengetahui informasi lain seputar blockchain, AR, VR, dan teknologi imersif metaverse lainnya.

Tertarik untuk menggunakan layanan virtual reality dan augmented reality? Segera hubungi customer service kami melalui WhatsApp untuk bertanya dan berkonsultasi secara gratis. Rasakan juga pengalaman dunia virtual yang menakjubkan dengan bergabung bersama MetaNesia.